Comment Adobe industrialise la production de contenu sans sacrifier la qualité de marque

De la content supply chain agentique à Brand Intelligence, Aaron Finegold (Adobe) décrit une industrialisation du contenu qui mise autant sur le déterministe que sur le génératif.

Au Adobe Summit 2026 de Las Vegas, Aaron Finegold pilote l’un des sujets majeurs annoncés lors de l’événement : la transformation de la chaîne de production de contenu marketing par l’IA agentique. Head of Product Marketing pour la Customer Experience Orchestration, il couvre Brand Intelligence, Firefly Creative Production et la façon dont ces briques s’articulent pour permettre aux grandes marques de produire du contenu à l’échelle sans sacrifier la qualité. Rencontre.

Les entreprises produisent de plus en plus de contenu, sur de plus en plus de canaux. Concrètement, quand une grande marque vient vous voir, quel est le problème qu’elle décrit le plus souvent ?

Ce qui est intéressant, c’est que toutes les entreprises ne cherchent pas à produire plus. Deux grandes entreprises tech m’ont dit récemment que ce n’était pas leur objectif. L’une a dit que le volume serait peut-être un sous-produit de leur démarche, mais pas l’objectif en soi. L’autre a même dit qu’elle voulait un peu moins. Mais peu importe dans quel camp vous vous situez – plus, pareil ou moins -, tout le monde veut du plus rapide et du meilleur. Et c’est vraiment ce que nous estimons être notre rôle : apporter de la vitesse et de la qualité d’une façon que d’autres capacités IA ne peuvent pas faire.

Tout le monde veut du plus rapide et du meilleur.

La qualité fait vraiment partie de notre ADN. Nous avons une compréhension très profonde de ce qui rend une marque viable, de la façon dont la valeur de marque se crée, de la façon dont les marques s’expriment au niveau entreprise. La plupart des outils disponibles sur le marché visent à aider des individus à créer un asset à la fois. Notre approche, c’est de réfléchir en profondeur à la façon de passer d’un seul asset à de nombreuses variantes, ou même d’inputs multiples à un très grand nombre de permutations de chaque contenu. Vous obtenez beaucoup plus de vélocité quand vous êtes construit pour la mise à l’échelle. Et ça inclut les actions génératives dans le workflow, mais aussi la revue et la validation, qui est ce qui ralentit nombre d’entreprises. L’idée, c’est qu’elles n’aient pas à sacrifier la qualité pour atteindre l’échelle et la vitesse.

Adobe parle de « content supply chain » depuis plusieurs années. Qu’est-ce qui a changé depuis l’an dernier avec l’arrivée de l’IA agentique ? On est passé de quoi à quoi ?

Il y a toujours eu une content supply chain, et elle était entièrement gérée par des humains. En 2023, nous avons commencé à avoir une content supply chain accélérée par l’IA générative. C’est en grande partie ce dont nous parlions encore au Summit l’an dernier, même si nous avions la vision des agents et de la réalité agentique à venir. Mais dans la content supply chain en tout cas, nous n’avions pas encore d’entreprises en production utilisant des capacités agentiques comme c’est le cas maintenant.

Qu’est-ce qui a changé ? Je vois deux choses. La première, c’est la profondeur du contexte et de l’intelligence d’entreprise comme couche sous-jacente dont tout agent a besoin pour prendre des actions productives au nom de l’utilisateur. C’est vraiment ce que Brand Intelligence cherche à faire : être le carburant qui permet aux agents de prendre les bonnes décisions. La deuxième, c’est que nous avons créé la possibilité d’assigner des tâches dans un workflow de bout en bout. Pas seulement un workflow de production créative, mais vraiment du brief jusqu’à l’activation dans le canal, l’enregistrement dans le DAM (Digital Asset Management, la bibliothèque centrale d’assets, ndlr) et l’obtention des analytics. Dans ce flux complet, vous pouvez maintenant assigner des étapes soit à des collaborateurs humains, soit à des agents IA. Je pense que ces deux choses représentent un grand pas vers la content supply chain agentique.

Adobe Brand Intelligence est présenté comme un moteur qui apprend en continu de l’identité de marque. En pratique, comment cela se met-il en place ? Une entreprise arrive avec quoi, et qu’obtient-elle au bout de combien de temps ?

Adobe Brand Intelligence, c'est quoi ?

Quand on décrit Brand Intelligence en une phrase, on commence presque toujours par cette idée d’apprentissage continu. La raison, c’est que quiconque a observé des marques sur une certaine durée sait qu’elles évoluent : le ton, la personnalité, la façon dont elles s’expriment. Pas forcément un grand rebranding, ça peut être des adaptations très légères et subtiles dans le message ou dans les visuels. Même Adobe, par exemple, a des traitements spécifiques de son logo que nous avons adaptés pour certains événements.

Concrètement, quand on entraîne le modèle, nos ingénieurs déployés sur site, notre équipe produit et notre équipe de recherche en machine learning vont chez le client pour travailler avec eux à constituer le corpus de données d’entraînement. Ça prend environ deux mois selon notre expérience. Dans ce processus, la couche d’intelligence est aussi équipée pour recevoir des flux automatiques de nouvelles informations sur l’évolution de la marque, pour pouvoir être continuellement alimentée.

Nous ne voulons pas que quelqu’un ait à réentraîner le système un an plus tard et y passer encore deux mois parce que la marque a évolué.

Vous dites que ce système remplace les guidelines statiques. Mais un brand book, un directeur artistique sait l’interpréter avec du contexte et de la nuance. Comment une IA peut-elle reproduire ce jugement ?

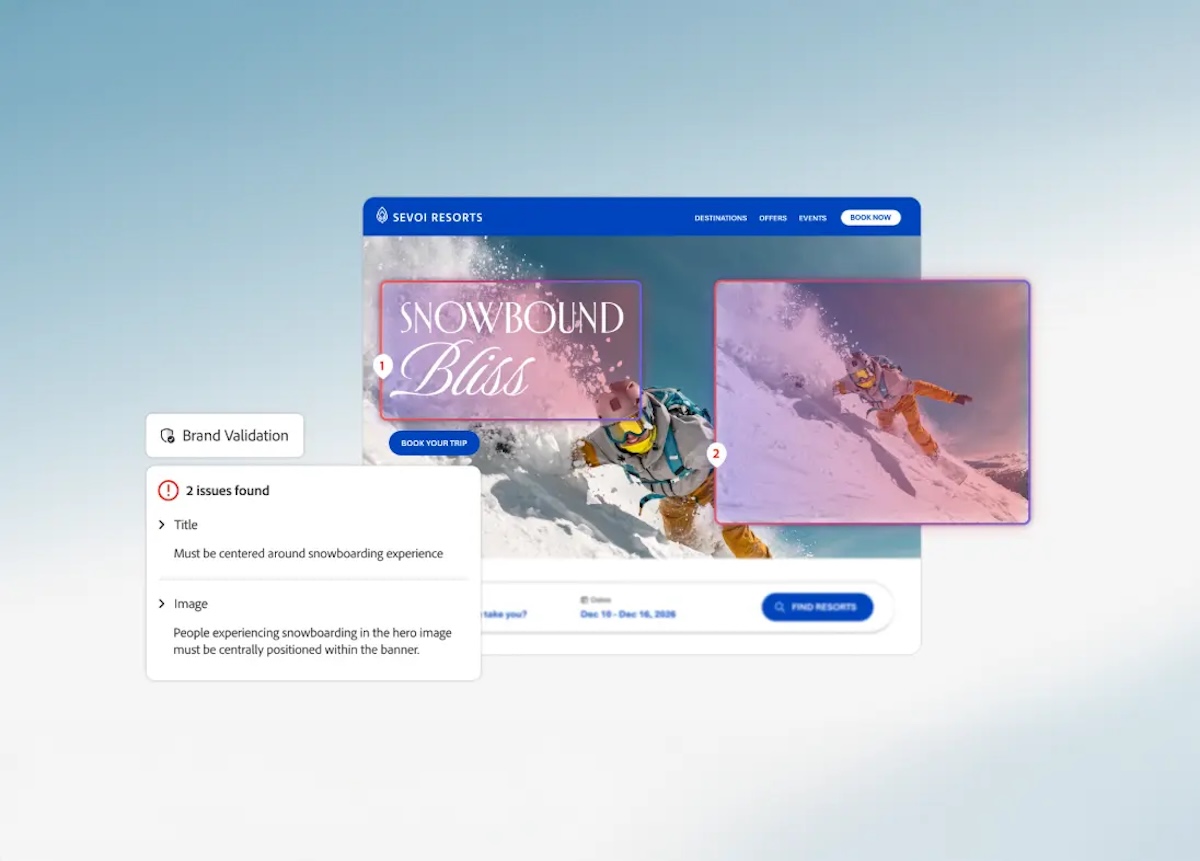

C’est la bonne question. Jusqu’à présent, ce n’était pas possible. Les seules offres de brand checking sur le marché fonctionnaient à ce niveau très statique : ce n’est pas le bon code hex, ce n’est pas le bon logo, vous avez inversé le logo de façon inappropriée… Nous avons appris que ça ne représente que 20 % de la valeur. Un directeur artistique, lui, a toute la connaissance, le savoir-faire, la formation et l’expérience vécue pour regarder un asset dans son ensemble et dire : « Cet asset fait partie d’une campagne plus large, d’une histoire de marque plus large. Dans cet asset précis, maintenant que je vois le titre, le texte et l’image, on va passer d’un centrage à un alignement à gauche – même si ça pourrait techniquement être « off-brand » – parce que, dans tel contexte, c’est plus dans l’esprit de la marque de briser la règle que de la suivre. » C’est un niveau de jugement et de subjectivité immense.

Nous y sommes parvenus en entraînant la couche d’intelligence sur toutes les annotations. L’un de nos premiers clients avait 800 000 annotations en un an : les revues créatives, les allers-retours, les feedbacks et les rejets qui ont permis au système de comprendre que, pour tel asset, même en suivant toutes les règles, ces éléments ont été modifiés pour être plus dans l’esprit esthétique de la marque. Ce qu’il acquiert de ça, c’est la même reconnaissance de pattern qu’un directeur créatif : j’ai maintenant vu la marque, je l’ai vue s’exprimer en contexte, je l’ai vue activée sur le marché et je connais sa vraie essence.

Le système se nourrit des feedbacks qualitatifs : annotations, assets rejetés. Est-ce que ça signifie que les équipes doivent changer leurs habitudes de travail pour l’alimenter, ou c’est transparent ?

Le workflow va changer dans le sens où vous aurez désormais trois types d’assets : ceux créés par des humains, ceux créés par des humains avec de l’IA quelque part dans la boucle, et ceux entièrement assemblés par Brand Intelligence. Ces trois types peuvent passer par l’étape de validation, où la couche d’intelligence détermine si c’est conforme ou non. Il y aura moins d’annotations créatives, parce qu’il y aura moins de cas où des créatifs seniors doivent intervenir. Et c’est une très bonne chose parce qu’aujourd’hui, dans beaucoup d’entreprises, des directeurs créatifs et des juristes passent des dizaines d’heures par semaine à faire de la revue et de la validation d’assets marketing. Ce n’est pas une bonne utilisation du temps.

Cela dit, il se peut que Brand Intelligence signale parfois un asset comme étant un cas trop limite pour qu’il prenne une décision. Dans ce cas, il va le signaler pour une revue humaine, parce que les données d’entraînement ne l’ont pas préparé pour cette situation exacte. Mais je pense que c’est rare. Dans la plupart des cas, avec suffisamment de données d’entraînement, il sera capable de regarder quelque chose qu’il n’a jamais vu et de faire la bonne évaluation.

La qualité du contenu généré par l’IA reste un sujet de débat. Quelle part du contenu produit via cette chaîne est utilisable tel quel, sans retouche humaine ?

Beaucoup de clients commencent à être très sélectifs sur là où ils utilisent des capacités génératives, exactement pour cette raison. Certains d’entre eux trouvent de bons résultats avec Firefly Creative Production et Brand Intelligence, mais sans rien faire de génératif. Concrètement, dans les workflows, ils prennent des images en input, les recadrent, les redimensionnent, retirent les arrière-plans, appliquent du texte via un assemblage de données déterministe, comme un upload de fichier CSV, et font de la correction colorimétrique. Mais rien dans tout ça ne fait appel à un modèle génératif. Pas de Firefly, pas de Nano Banana ou autre…

Du côté de Brand Intelligence, ce qui peut paraître surprenant vu la puissance de la solution, c’est qu’elle non plus n’est pas générative. La compétence de validation repose sur des modèles de vision par ordinateur spécialisés, gouvernés par un moteur de raisonnement, qui regardent un asset et indiquent ce qui est conforme ou non. Et la compétence d’assemblage par instruction consiste à aller dans le DAM, trouver des éléments préapprouvés (photos, illustrations, textes, logos) et les assembler sur la surface adaptée, que ce soit Figma, Photoshop ou Illustrator. Pas de génération de nouveaux médias.

De nombreux clients disent qu’ils ne sont pas intéressés par le génératif. Parce que quand on parle d’automatisation à l’échelle, personne ne veut devoir faire des modifications manuelles après avoir fait tourner mille assets dans un workflow. Les modifications manuelles sont acceptables quand c’est un par un, 30 secondes de retouche valent toujours mieux que trois heures à créer de zéro. Mais à l’échelle, vous ne pouvez pas vous permettre ça. Et même quand un modèle est assez bon, ce n’est pas toujours fiable : un deuxième prompt peut donner quelque chose de différent. Il y a donc un désir très fort d’utiliser les capacités déterministes ou non génératives pour atteindre ce niveau de qualité de marque, de façon scalable et automatisée.

Si un directeur marketing vous dit « je veux industrialiser ma production de contenu avec l’IA mais je ne sais pas par où commencer », quelle est la première étape que vous lui recommandez ?

Nous faisons toujours un atelier de découverte de cas d’usage. Nous posons des questions sur les workflows existants et nous disons : « Dites-nous où vous avez des problématiques de volume, ou où vous prenez un asset hero pour créer des variantes. » Hier encore, je parlais avec un client qui m’a dit : « Nous faisons du contenu autour de notre sponsoring sportif, nous avons la création principale, et ensuite nous produisons environ 100 variantes. » C’est exactement le genre de choses qu’on écoute, qui nous dit qu’il y a du travail existant, clairement fait manuellement aujourd’hui, par un studio créatif interne ou une agence externe. Et ce qu’on veut faire, c’est prendre ce travail et le mettre dans un workflow standardisé qui peut être exécuté par la bonne personne dans l’entreprise, en permanence, chaque fois que ce workflow est nécessaire.

Avec toutes ces innovations rapides, est-ce que vous pensez que certaines entreprises peuvent avoir peur ou se sentir perdues ?

Absolument. Je vois quatre peurs :

- La première, c’est la peur de l’adoption précoce : l’obsolescence, que les capacités dépassent ce dans quoi on a investi.

- La peur opposée, c’est la peur de ne rien essayer et de se retrouver vraiment en retard par rapport à ceux qui ont essayé, appris et fait fonctionner ça.

- La troisième, c’est la peur de la dégradation de la qualité, c’est universel.

- Et la quatrième, c’est la peur que la partie technologique soit résolue, mais que la gestion du changement humain soit un vrai bourbier : une énigme très difficile à comprendre, faite d’émotions, de science, de logique, de processus, de hiérarchie, d’incitations… toutes ces choses qui doivent être orchestrées ensemble pour qu’un programme réussisse.

Il n’existe aucun produit Adobe, aucun produit tech au monde qui puisse résoudre la gestion du changement humain.

Aaron Finegold, Head of Product Marketing, Customer Experience Orchestration, Adobe

Aaron Finegold pilote le product marketing de la Customer Experience Orchestration chez Adobe, avec un périmètre centré sur la content supply chain agentique, Brand Intelligence et Firefly Creative Production. Il est l’un des principaux interlocuteurs sur la façon dont Adobe aide les grandes organisations à industrialiser leur production de contenu marketing à l’échelle entreprise.

Nous avons besoin de vous !

Nous réalisons une courte enquête pour comprendre vos besoins et mieux y répondre sur BDM.

Je donne mon avis