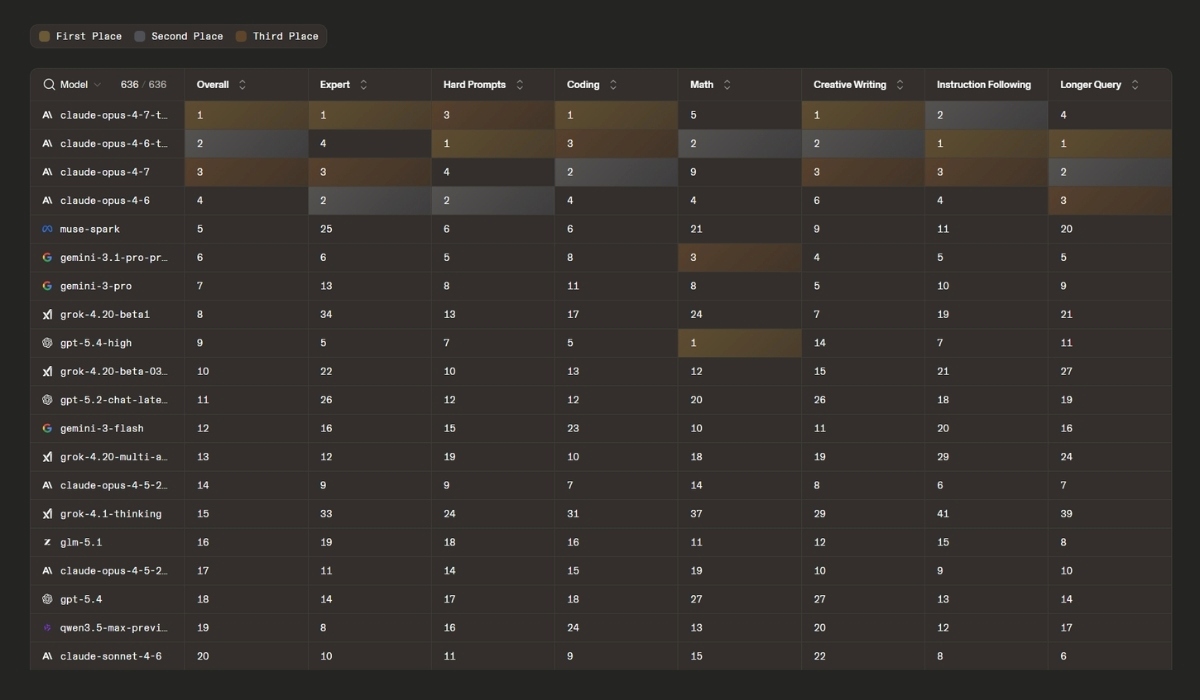

Top 20 des modèles d’IA les plus performants en avril 2026 : le classement complet

En avril 2026, les modèles d’Anthropic dominent plus que jamais. En tête dans le classement général, ils devancent également leurs concurrents dans la plupart des catégories.

Cela fait désormais plusieurs mois que ChatGPT se fait voler la vedette par ses concurrents, Gemini et Claude en tête. Si l’agent conversationnel d’OpenAI reste de loin l’outil le plus utilisé, sa domination tend à s’étioler peu à peu. En cause : des modèles de langage moins dominants qu’avant, qui semblent même accumuler du retard sur certains rivaux dans de nombreux domaines. Le benchmark collaboratif Arena suit cette évolution et propose un classement en direct des modèles les plus performants. En avril 2026, les technologies de Claude se révèlent plus performantes que jamais, tandis qu’OpenAI peine à relever la barre. On fait le point !

Les 10 modèles d’IA les plus performants en avril 2026

Le mois dernier, Anthropic réalisait la prouesse de truster les deux premières places du leaderboard. Mais la société à l’origine de Claude n’en était qu’à son tour de chauffe. En avril, ses modèles accaparent les quatre premières places, grâce à Opus 4.6 et Opus 4.7 (versions standard et thinking). Il faut descendre à la 9e position pour voir apparaître un modèle d’OpenAI (GPT-5.4 high), devancé par Gemini, Grok et même Meta, qui obtient une inhabituelle 5e place.

Voici les 10 modèles de langage les plus performants en avril 2026, toutes tâches confondues :

- Claude Opus 4.7 « thinking »

- Claude Opus 4.6 « thinking »

- Claude Opus 4.7

- Claude Opus 4.6

- Muse Spark

- Gemini 3.1 Pro Preview

- Gemini 3 Pro

- Grok 4.20 Beta 1

- GPT-5.4 High

- Grok 4.20 Beta 0309 « reasoning »

Les meilleurs modèles d’IA par catégorie en avril 2026

Au-delà du classement général, la LMArena propose des leaderboards thématiques qui permettent d’identifier plus finement les points forts de chaque modèle selon les usages. Voici les tendances observées en avril 2026 :

- Génération de texte : Anthropic confirme sa mainmise sur cette catégorie, avec les versions « thinking » et standard de Claude Opus 4.7 aux deux premières places, devant Claude Opus 4.6 « thinking ». Muse Spark, développé par Meta, s’intercale en cinquième position, tandis que Gemini 3.1 Pro Preview et Gemini 3 Pro complètent le top 7.

- Développement web : Anthropic écrase toujours la concurrence dans cette catégorie en plaçant ses modèles Claude Opus 4.7 et 4.6 aux quatre premières positions. GLM-5.1, développé par Zhipu AI, s’invite en cinquième place, devant Claude Sonnet 4.6.

- Analyse d’image : Anthropic s’impose également sur cette catégorie, avec les versions « thinking » et standard de Claude Opus 4.7 en tête. Muse Spark prend la quatrième place, tandis que Gemini 3 Pro et GPT-5.2 apparaissent en sixième et septième positions.

- Génération d’images : Google prend la tête de cette catégorie avec Gemini 3.1 Flash Image Preview, devant GPT-Image 1.5 High Fidelity d’OpenAI. Deux autres variantes de Gemini 3 Pro Image occupent les troisième et quatrième places. La retouche d’images est la seule catégorie dominée par OpenAI, ChatGPT Image Latest High Fidelity se plaçant devant quatre modèles Gemini.

- Recherche web : Claude Opus 4.6 Search conserve la première place, devant Gemini 3.1 Pro Grounding. Claude Sonnet 4.6 Search complète le podium, tandis que GPT-5.2 Search et Gemini 3 Flash Grounding suivent de près.

Arena : les critères du classement

Pour offrir un panorama aussi impartial que possible du secteur, la LMArena mise sur l’évaluation collective. La plateforme organise des face-à-face anonymes entre modèles, tous soumis au même prompt, afin que les utilisateurs puissent comparer directement les réponses et choisir celle qu’ils jugent la plus aboutie. À l’issue de chaque duel, un score Elo est ajusté pour chaque participant. Ce mécanisme valorise les victoires contre des modèles mieux classés et sanctionne plus fortement les revers face à des concurrents moins bien positionnés, ce qui permet d’affiner progressivement la hiérarchie.

Nous avons besoin de vous !

Nous réalisons une courte enquête pour comprendre vos besoins et mieux y répondre sur BDM.

Je donne mon avis