Avec sa V4, DeepSeek ambitionne de rivaliser avec Claude et ChatGPT

La startup chinoise dévoile DeepSeek V4, une nouvelle génération de modèles disponible en open source et en pré-version, avec deux déclinaisons aux profils distincts. L’annonce intervient le même jour que le lancement de GPT-5.5 par OpenAI.

DeepSeek revient sur le devant de la scène un an et demi après avoir bousculé l’industrie mondiale de l’IA. Début 2025, la startup de Hangzhou avait surpris le secteur avec des modèles affichant des performances proches des références américaines à un coût de développement nettement inférieur. Depuis quelques mois, l’entreprise s’était faite plus discrète. Ce vendredi 24 avril, elle publie DeepSeek V4 en pré-version open source. Le modèle viendra concurrencer GPT-5.5, annoncé le même jour.

🚀 DeepSeek-V4 Preview is officially live & open-sourced! Welcome to the era of cost-effective 1M context length.

🔹 DeepSeek-V4-Pro: 1.6T total / 49B active params. Performance rivaling the world’s top closed-source models.

🔹 DeepSeek-V4-Flash: 284B total / 13B active params.… pic.twitter.com/n1AgwMIymu— DeepSeek (@deepseek_ai) April 24, 2026

Pour afficher ce contenu issu des réseaux sociaux, vous devez accepter les cookies et traceurs publicitaires.

Ces cookies et traceurs permettent à nos partenaires de vous proposer des publicités et des contenus personnalisés en fonction de votre navigation, de votre profil et de vos centres d’intérêt.Plus d’infos.

Un modèle disponible en deux versions

DeepSeek V4 se décline en deux versions aux architectures distinctes.

- DeepSeek V4-Pro : 1 600 milliards de paramètres au total, dont 49 milliards actifs. Positionné sur les cas d’usage avancés, avec des capacités agentiques renforcées par rapport à la génération précédente. DeepSeek indique qu’il est déjà utilisé en interne pour ses workflows de codage agentique, et qu’il est intégré nativement à Claude Code et à des outils comme OpenCode.

- DeepSeek V4-Flash : 284 milliards de paramètres au total, dont 13 milliards actifs. Conçu pour les usages rapides et économiques, ses capacités de raisonnement s’approchent de celles du V4-Pro selon la startup, avec des performances comparables sur les tâches agentiques simples.

Les deux modèles supportent un contexte d’un million de tokens. DeepSeek présente cette fenêtre étendue comme l’une des plus compétitives du marché, obtenue à des coûts de calcul et de mémoire « drastiquement réduits » grâce à une architecture d’attention repensée : compression au niveau des tokens et mécanisme DSA (DeepSeek Sparse Attention).

DeepSeek V4 : quelles améliorations concrètes ?

DeepSeek met en avant trois domaines dans lesquels V4-Pro progresse par rapport à V3.

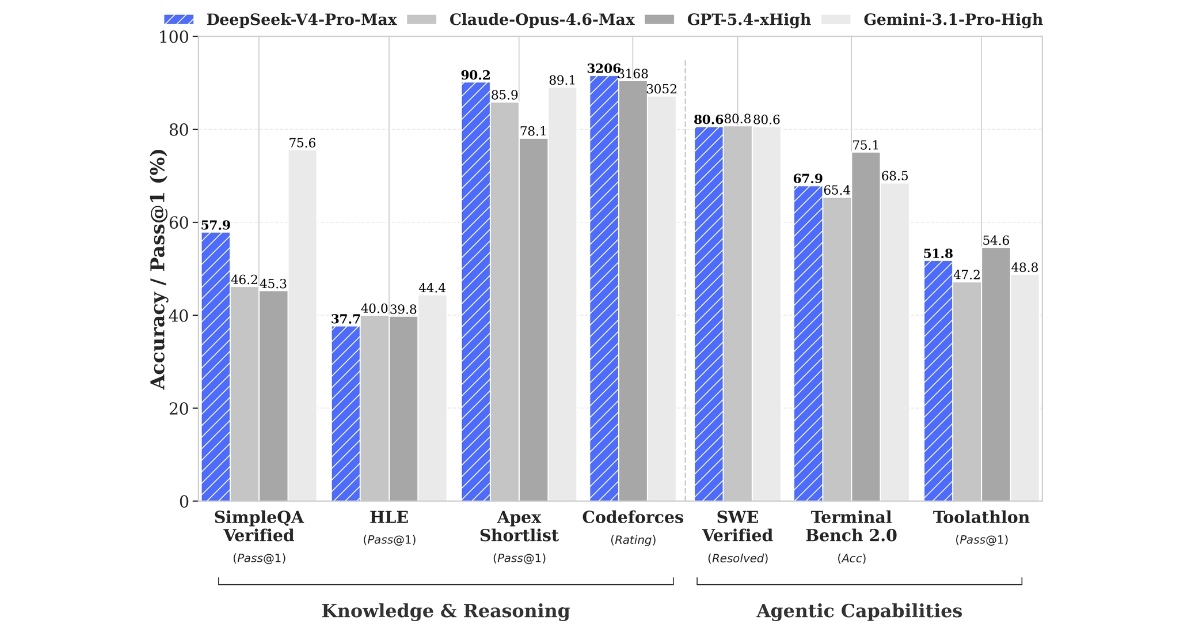

Les capacités agentiques sont présentées comme la principale évolution. Sur Codeforces, V4-Pro devance GPT-5.4 et Gemini-3.1-Pro. Sur SWE Verified, qui mesure la résolution autonome de tickets logiciels, les trois modèles sont à quasi-égalité autour de 80 %.

Le raisonnement mathématique et scientifique constitue le deuxième axe. DeepSeek indique que V4-Pro dépasse les modèles open source actuels en maths, STEM et code, et rivalise avec les meilleurs modèles closed source. Sur Apex Shortlist, il obtient 90,2 contre 85,9 pour Claude Opus 4.6 et 78,1 pour GPT-5.4.

Troisième point : la connaissance générale. V4-Pro devance Claude Opus 4.6 et GPT-5.4 sur SimpleQA Verified, mais reste en retrait face à Gemini-3.1-Pro, qui conserve une avance significative sur ce critère.

Vous pouvez consulter l’ensemble du rapport technique sur la page Hugging Face du modèle.

DeepSeek V4 accessible gratuitement dès aujourd'hui

- Via l’interface chat.deepseek.com, en Mode Expert (V4-Pro) et Mode Instantané (V4-Flash)

- Via l’API DeepSeek, avec les identifiants de modèle deepseek-v4-pro et deepseek-v4-flash. Les API OpenAI ChatCompletions et Anthropic sont supportées.

Les anciens modèles deepseek-chat et deepseek-reasoner seront définitivement retirés le 24 juillet 2026.

Nous avons besoin de vous !

Nous réalisons une courte enquête pour comprendre vos besoins et mieux y répondre sur BDM.

Je donne mon avis