OpenAI dévoile Sora, son générateur de vidéos par IA : voici les premières images

Créateur de ChatGPT et DALL-E, OpenAI a présenté Sora, son générateur de vidéos par IA, avec plusieurs exemples impressionnants, mais perfectibles.

Après ChatGPT et DALL-E, son agent conversationnel et son générateur d’images par IA, OpenAI a dévoilé Sora, un générateur de vidéo, « capable de créer des cènes réalistes et créatives à partir d’instructions textuelles », décrit la société dans un blog post. Dans ses dernières phases de test, ce nouveau modèle apparaît particulièrement impressionnant dans les exemples partagés par OpenAI.

Sora, le modèle text-to-video d’OpenAI, se dévoile

Sora est donc un générateur de vidéos par IA. Selon OpenAI, ce nouveau modèle peut générer des vidéos d’une durée maximale d’une minute, « en respectant la qualité visuelle et la cohérence avec le prompt de l’utilisateur ». Concrètement, il sera possible avec Sora de générer des vidéos de la même manière qu’on génère une image avec des outils comme DALL-E ou Midjourney. « Sora est capable de gérer des scènes complexes avec plusieurs personnages, des types de mouvements spécifiques, et des détails précis du sujet et de l’arrière-plan », explique OpenAI.

Le modèle comprend non seulement ce que l’utilisateur a demandé dans le prompt, mais également comment ces éléments existent dans le monde physique.

Les développeurs précisent que le modèle possède une compréhension approfondie des requêtes, lui permettant de les interpréter avec précision et de générer des personnages réalistes et convaincants, capables de montrer des émotions. En outre, Sora est capable de réaliser plusieurs plans au sein d’une seule séquence générée, en conservant les personnages et le style visuel.

Des exemples de vidéos générées par Sora impressionnants

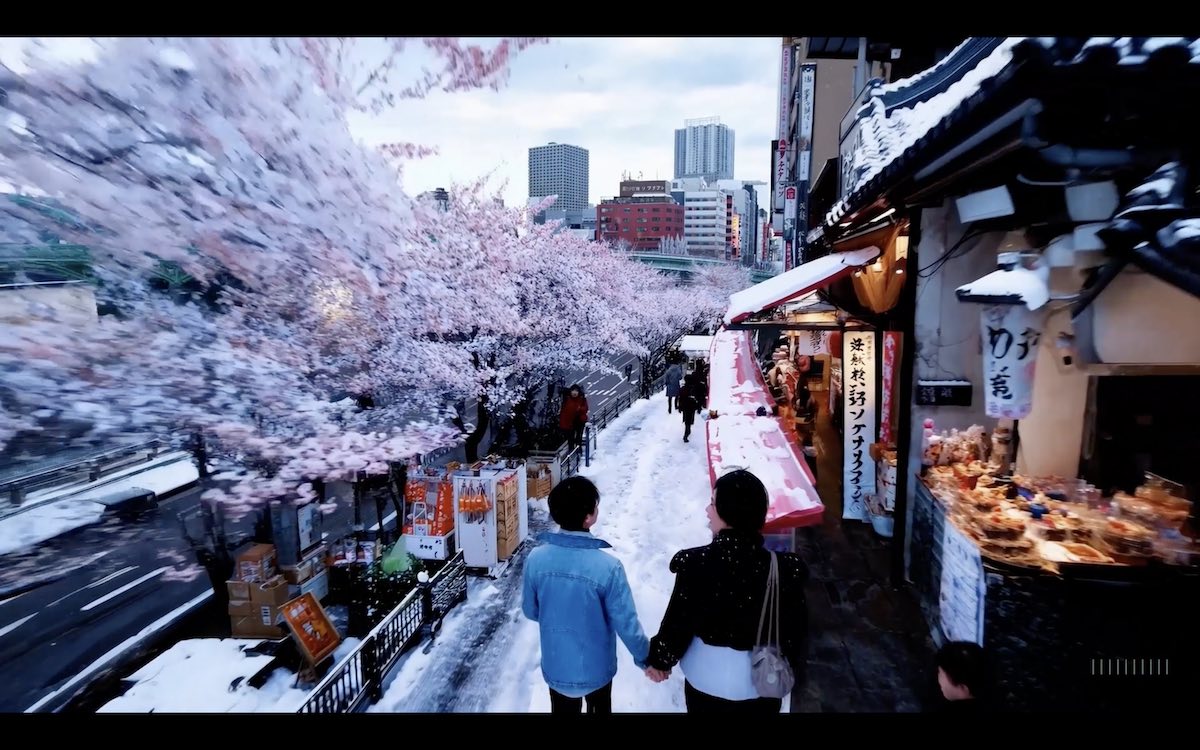

Dans son blog post et par l’intermédiaire de son compte X, OpenAI a partagé des exemples des séquences vidéo que semble capable de générer Sora, accompagnés des prompts utilisés. Et ceux-ci sont impressionnants :

Cette vidéo répond à la requête suivante (en anglais à l’origine) : la magnifique ville de Tokyo enneigée est animée. La caméra se déplace dans la rue animée de la ville, suivant plusieurs personnes profitant du beau temps neigeux et faisant des achats aux étals à proximité. De superbes pétales de sakura volent dans le vent avec les flocons de neige.

Cette séquence a été générée à l’aide de la requête suivante (en anglais à l’origine) : Une bande-annonce de film présentant les aventures d’un homme de l’espace de 30 ans portant un casque de moto tricoté en laine rouge, ciel bleu, désert de sel, style cinématographique, tourné en pellicule 35mm, couleurs vives.

Ce troisième exemple répond à la requête (en anglais à l’origine) : L’histoire de la vie d’un robot dans un décor cyberpunk.

Encore en test, Sora est perfectible, prévient OpenAI

Malgré les nombreux exemples partagés par Sora, le modèle reste en phase de test et à perfectionner. Il faudra donc attendre encore un peu pour pouvoir l’essayer. Si les séquences dévoilées ont probablement été triées sur le volet, OpenAI diffuse également quelques vidéos montrant les faiblesses de l’outil. « Le modèle actuel (…) peut avoir du mal à simuler avec précision la physique d’une scène complexe, et ne pas comprendre des cas spécifiques de cause à effet. »

Une personne peut mordre dans un cookie, mais par la suite, le cookie peut ne pas avoir de marque de morsure.

Le clonage d’entités est un des problèmes de Sora.

Des détails spatiaux peuvent échapper au modèle, qui confond parfois sa droite et sa gauche, crée des mouvements de caméra « physiquement invraisemblables », fait apparaître spontanément des éléments (animaux, personnes) « dans les scènes contenant de nombreuses entités », ne parvient pas à donner un rendu rigide à certains objets… « Simuler des interactions complexes entre des objets et plusieurs personnages est un défi pour le modèle, ce qui entraîne parfois des générations humoristiques », commente OpenAI à propos de l’anniversaire un peu douteux de cette grand-mère.

Quels risques et mesures sécuritaires avec Sora ?

Sora est actuellement entre les mains des red teamers d’OpenAI, l’équipe qui évalue « les zones critiques » du générateur, notamment au sujet des risques légaux, moraux et éthiques. Il s’agit notamment d’experts de la désinformation, des contenus haineux et des préjugés, « qui testent le modèle de manière contradictoire ». Les mêmes règles qui s’appliquent à DALL-E, le générateur d’images, seront utilisées pour Sora : les requêtes contenant une violence extrême, du contenu sexuel, des images haineuses, une ressemblance avec une célébrité seront donc bannies.

Nous développons des outils pour aider à détecter les contenus trompeurs, tels qu’un classificateur de détection capable de déterminer quand une vidéo a été générée par Sora.

Alors que les modèles de générateurs de vidéo existants, comme Gen-2 ou ADFA, ont été à l’origine de nombreux deepfakes, et qu’OpenAI et Microsoft viennent d’alerter sur l’utilisation malveillante de leurs chatbots, il faudra que Sora assure un usage responsable. « Nous mobiliserons les décideurs politiques, les éducateurs et les artistes du monde entier pour comprendre leurs préoccupations et identifier des cas d’utilisation positifs de cette nouvelle technologie », conclut OpenAI.