L’IA peut-elle influencer les élections prévues dans le monde en 2024 ?

En 2024, l’IA pourrait transformer les usages dans les campagnes politiques, mais aussi alimenter la diffusion de contenus trompeurs.

L’année 2024 sera particulièrement riche en événements électoraux. Selon les calculs du Monde, la moitié de la population mondiale vit dans un pays où se tiendra une élection cette année. Parmi les scrutins les plus attendus figurent les élections américaines de novembre, qui devraient voir s’affronter l’actuel président Joe Biden et son prédécesseur Donald Trump, ainsi que les élections européennes.

Alors que de nombreux scrutins électoraux ont été entachés de tentatives de manipulation en ligne ces dernières années, une nouvelle arme a émergé depuis deux ans : l’Intelligence artificielle générative. Et celle-ci a déjà commencé à s’immiscer dans les campagnes politiques.

L’IA au service des équipes de campagnes

L’IA pour la prospection téléphonique

L’intelligence artificielle pourrait bien devenir un nouvel outil à exploiter pour les équipes de campagne. Aux États-Unis, certaines personnalités politiques commencent déjà à s’emparer de l’IA pour des campagnes de diffusion de masse. Peter Dixon, candidat démocrate à la Chambre des représentants pour l’État de Californie, et Shamaine Daniels, candidate en Pennsylvanie, se sont notamment offert les services d’une « intelligence artificielle bénévole », nommée respectivement Jennifer (pour Peter Dixon) et Ashley (pour Shamaine Daniels). Développée par la startup californienne Civox, cette IA est en mesure d’énoncer des éléments du programme et de répondre directement aux questions des électeurs par téléphone. Bien que « terrifié » par cette technologie, Peter Dixon juge son utilisation inévitable.

L’IA arrive, cela ne sert à rien de s’en cacher et il vaut mieux que nous ouvrions la voie, plutôt que d’autres pays comme la Chine, indique Peter Dixon à l’AFP.

Si cet outil peut s’avérer utile pour convaincre, il permet également de recueillir des données précieuses relatives aux préoccupations des électeurs. Auprès de TF1, Shamaine Daniels explique : « Ashley nous permet de connaître les sujets qui comptent réellement pour les gens. On s’assure ainsi que les messages que l’on porte sont les bons, que cela intéresse les électeurs. Et puis, ça libère du temps à mon équipe de campagne pour des choses plus importantes. »

L’IA au service de l’image

Peter Dixon n’a pas limité l’utilisation de l’IA au démarchage téléphonique. Cet ancien collaborateur d’Hillary Clinton au département d’État a aussi intégré l’intelligence artificielle dans ses vidéos de campagne pour renforcer sa stature de vétéran. Dans son clip de candidature, le démocrate troque, grâce à l’IA, sa chemise pour une tenue militaire, et le décor de son pavillon résidentiel pour ceux des rues d’Irak et d’Afghanistan.

Dans une approche plus offensive, le Parti républicain a diffusé, en avril dernier, un clip vidéo intitulé « Beat Biden » (Battre Biden, ndlr), visant à offrir une « vision générée par l’IA de l’avenir possible du pays si Joe Biden est réélu en 2024 », est-il indiqué dans la description de la vidéo. Le Grand Old Party n’a pas hésité à utiliser des avatars de son adversaire et de sa vice-présidente, Kamala Harris, plongés dans un monde dystopique.

L’IA au service de la désinformation

Dans les deux exemples mentionnés précédemment – ceux du démarchage téléphonique et du clip de campagne -, l’utilisation de l’IA est assumée. La voix de Jennifer/Ashley est délibérément robotique, dans le but d’éviter de tromper les interlocuteurs, et la vidéo du Parti républicain porte la mention « conçu entièrement avec des images IA ». Mais des exemples d’utilisation trompeuse ont d’ores et déjà été constatés.

En Slovaquie, le candidat progressiste aux législatives Michal Simecka a été victime d’un clonage de voix à l’automne 2023, dont l’auteur demeure inconnu, lors de la période de réserve des élections législatives (les 48h précédant le scrutin). Un extrait sonore le présentait en train de conspirer avec une journaliste pour manipuler le résultat de l’élection. Aux États-Unis, à l’approche de la présidentielle, les trucages utilisant l’IA se multiplient également. Début mars, la BBC rapportait que des partisans de Donald Trump avaient massivement partagé de fausses photos de lui avec des militants noirs sur les réseaux sociaux, afin de viser la communauté afro-américaine. De son côté, Joe Biden s’est retrouvé la cible d’un deepfake vocal, dans lequel il appelait les électeurs du New Hampshire à ne pas voter aux primaires démocrates. L’auteur de la tromperie a été révélé quelques semaines plus tard : il s’agissait de Steve Kramer, consultant pour le compte de l’opposant démocrate Dean Phillips.

These are fake AI generated images being posted by Trump supporters in an effort to garner support among Black voters. pic.twitter.com/45OL8rx82J

— Mike Sington (@MikeSington) March 4, 2024

Pour afficher ce contenu issu des réseaux sociaux, vous devez accepter les cookies et traceurs publicitaires.

Ces cookies et traceurs permettent à nos partenaires de vous proposer des publicités et des contenus personnalisés en fonction de votre navigation, de votre profil et de vos centres d’intérêt.Plus d’infos.

À ce jour, les efforts des usurpateurs semblent principalement se concentrer sur les formats photo et audio. Mais le développement de la vidéo par IA, en particulier grâce à des outils comme Sora, pourrait participer à rendre les manipulations encore plus confondantes.

Un rôle majeur pour les plateformes en ligne

Désinformation en ligne : de nombreux précédents

Durant la décennie passée, les plateformes ont été régulièrement pointées du doigt pour leurs défaillances dans la lutte contre la désinformation en ligne. Facebook a notamment été mise en cause pour son rôle lors de la présidentielle américaine de 2016, pour avoir transmis des données de millions d’utilisateurs à une société travaillant pour la campagne de Donald Trump (scandale Cambridge Analytica). Il a aussi été reproché au réseau social, ainsi qu’à Twitter et Google, d’avoir été incapables de lutter contre la diffusion fake news au cours de cette campagne.

Des cas similaires de manipulation de l’opinion ont été observés lors du référendum pour le Brexit ou dans le cadre de la guerre en Ukraine. Dès lors, l’attention sera portée sur les géants du numérique, qui devront être en mesure de lutter contre les nouvelles armes offertes par l’IA aux acteurs malveillants.

Un accord pour limiter l’impact de l’IA sur les élections

Si l’IA Act intègre un volet visant à lutter contre la manipulation d’opinion et l’ingénierie sociale, il ne cible pas spécifiquement les processus électoraux et ne s’applique que dans les pays membres de l’Union européenne.

Le 16 février, à l’occasion du forum sur la sécurité de Munich, les grands acteurs de l’IA, dont Google, Meta, OpenAI, Microsoft, Amazon, X, TikTok, Adobe ou Snapchat, ont signé un accord qui les engage à « aider à empêcher les contenus trompeurs générés par IA d’interférer dans les élections prévues cette année dans le monde ». Les entreprises qui produisent des outils d’IA assurent, par cet accord, atténuer les risques liés au contenu électoral trompeur, évaluer leurs modèles pour limiter les risques et partager les meilleures pratiques. Les plateformes qui diffusent du contenu, en particulier les réseaux sociaux, assurent qu’elles adopteront des mesures afin de détecter et de modérer le contenu trompeur généré par IA.

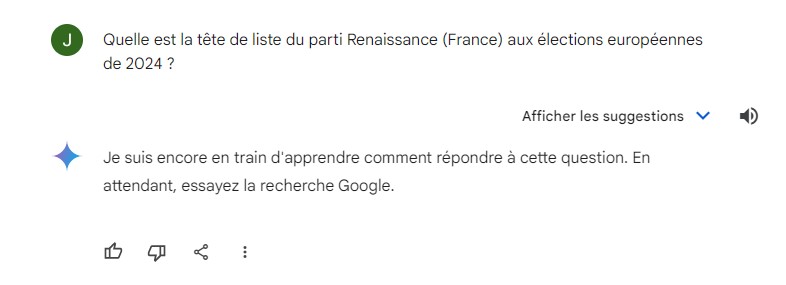

Certains solutions ont d’ores et déjà commencé à mettre en place des actions concrètes, comme Gemini, qui s’interdit désormais de répondre à toute question d’ordre politique.