GPT-5.4 mini et nano : OpenAI décline son modèle phare en versions optimisées pour les développeurs

Après GPT-5.4 Thinking lancé début mars, OpenAI complète sa gamme avec deux modèles plus légers optimisés pour le code, l’utilisation d’outils et les architectures agentiques.

GPT-5.4 mini et nano, deux modèles qui promettent une meilleure efficacité

OpenAI a annoncé deux nouvelles déclinaisons de GPT-5.4, pensées pour des usages spécifiques : GPT-5.4 mini et GPT-5.4 nano. Les deux modèles s’inscrivent dans la continuité directe de GPT-5.4, dont ils reprennent les capacités clés tout en privilégiant la vitesse et l’efficacité sur les performances brutes.

OpenAI présente GPT-5.4 mini comme « une version nettement améliorée de GPT-5 mini sur le code, le raisonnement, la compréhension multimodale et l’utilisation d’outils », avec une vitesse d’exécution plus de deux fois supérieure. L’entreprise le positionne pour les usages où la latence conditionne directement l’expérience produit : assistants de codage réactifs, sous-agents chargés de tâches de support, ou encore systèmes d’interprétation de captures d’écran en temps réel. Dans les architectures multi-agents, il peut prendre en charge des sous-tâches en parallèle pendant qu’un modèle plus grand, comme GPT-5.4, assure la coordination d’ensemble.

Comme son nom le laisse entendre, GPT-5.4 nano est la version la plus compacte de la famille GPT-5.4. OpenAI le recommande « pour la classification, l’extraction de données, le classement et les sous-agents qui gèrent des tâches de support plus simples », soit là où le coût et la vitesse priment sur la profondeur de raisonnement.

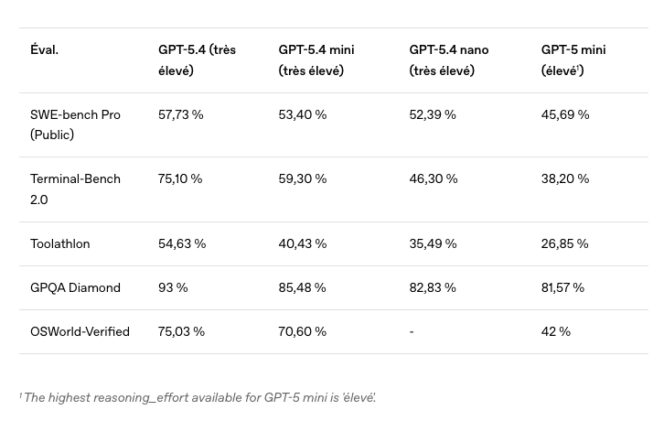

Des performances proches de GPT-5.4 sur plusieurs benchmarks

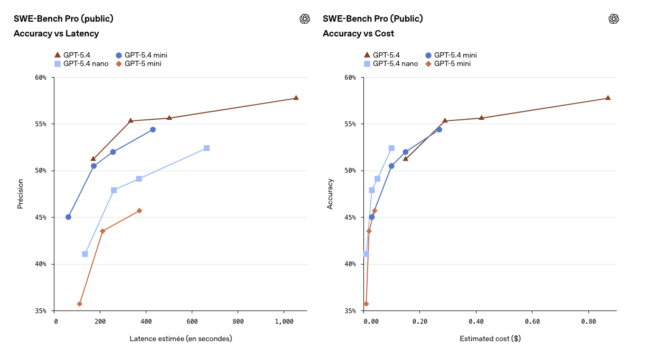

Côté performances, les nouveaux modèles d’OpenAI promettent de bons résultats. Sur le SWE-Bench Pro par exemple, qui évalue la capacité des modèles à résoudre des problèmes logiciels réels, GPT-5.4 mini obtient un score de 53,40 % et GPT-5.4 nano de 52,39 %, contre 57,73 % pour GPT-5.4 et 45,69 % pour GPT-5 mini.

Concrètement, GPT-5.4 mini se montre particulièrement adapté aux flux de travail de programmation qui bénéficient d’itérations rapides : modifications ciblées, navigation dans une base de code, génération front-end, boucles de débogage. Les graphiques publiés par OpenAI illustrent le compromis : à latence et à coût comparables, le modèle GPT-5.4 mini surpasse systématiquement GPT-5 mini et se rapproche des taux de réussite de GPT-5.4.

Des nouveaux modèles disponibles dans ChatGPT, Codex et l’API

GPT-5.4 mini est disponible dès aujourd’hui dans ChatGPT, Codex et l’API :

- Dans ChatGPT : le modèle est accessible aux utilisateurs Free et Go via la fonctionnalité Thinking. Pour les autres formules d’abonnement, le modèle sert de solution de secours en cas de limitation d’accès à GPT-5.4 Thinking.

- Dans l’API : il prend en charge les entrées texte et image, l’utilisation d’outils, l’appel de fonctions, la recherche web, la recherche de fichiers et le computer use (l’utilisation d’un ordinateur), avec une fenêtre de contexte de 400 000 tokens.

- Dans Codex : le modèle n’utilise que 30 % du quota GPT-5.4, ce qui permet de traiter des tâches de code moins complexes à moindre coût. Il est accessible dans l’application, le CLI, l’extension IDE et sur le web.

GPT-5.4 nano est quant à lui exclusivement disponible via l’API.

Les tarifs de GPT-5.4 mini et nano via l'API

- GPT-5.4 mini : 0,75 $ par million de tokens en entrée, 4,50 $ par million de tokens en sortie

- GPT-5.4 nano : 0,20 $ par million de tokens en entrée, 1,25 $ par million de tokens en sortie