Code Review : Claude déploie des agents IA pour inspecter les pull requests à votre place

Anthropic déploie Code Review dans Claude Code : un dispositif qui envoie une équipe d’agents analyser chaque pull request à la recherche de bugs, avant même qu’un développeur humain y jette un œil.

Régulièrement en tête des classements sur les tâches de code et de développement web, Claude a lancé Claude Code, un outil agentique qui permet aux développeurs de produire du code à grande vitesse, fin 2025. Cette accélération a cependant un revers : le volume de pull requests à relire a explosé, créant un goulot d’étranglement dans les cycles de livraison. C’est précisément ce problème qu’Anthropic entend résoudre avec Code Review. Voici comment il se présente.

Une équipe d’agents déployée sur chaque pull request

Code Review est une fonctionnalité intégrée à Claude Code qui automatise la revue de code à l’ouverture d’une pull request. Lorsqu’une PR est soumise sur un dépôt activé, plusieurs agents sont dispatchés en parallèle pour analyser les modifications depuis différents angles. Un agent agrégateur centralise ensuite les résultats, supprime les doublons et classe les anomalies par ordre de sévérité.

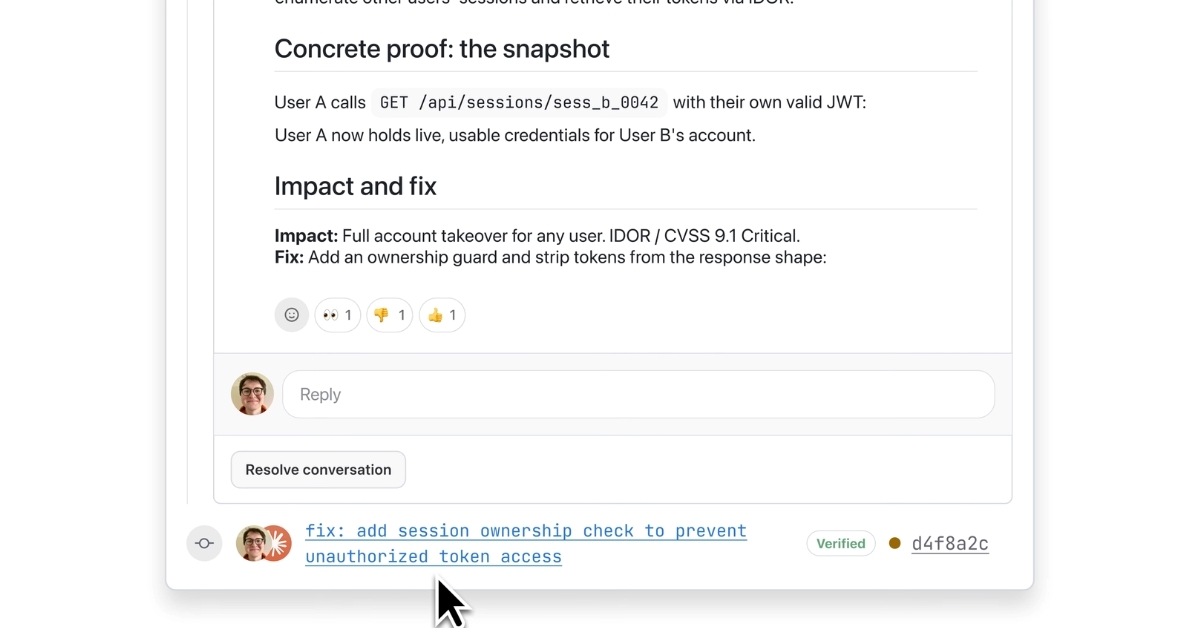

Le résultat s’affiche directement sur la pull request : un commentaire récapitulatif global, complété par des annotations en ligne sur chaque bug identifié. L’outil distingue trois niveaux de sévérité via un code couleur : rouge pour les anomalies critiques, jaune pour les points à surveiller, violet pour les bugs détectés dans du code adjacent non modifié par la PR. Les agents ne valident pas les pull requests, cette décision restant du ressort des développeurs.

Le périmètre est délibérément limité aux erreurs logiques, à l’exclusion des questions de style. Anthropic justifie ce choix par la volonté de réduire les faux positifs : tout bug logique identifié mérite, par définition, d’être corrigé. Les agents peuvent par ailleurs parcourir l’ensemble de la base de code, et pas uniquement les fichiers modifiés, pour détecter les effets de bord.

Un outil déjà éprouvé en interne chez Anthropic

Code Review répond à une problématique directement liée à l’essor de Claude Code : plus les développeurs produisent du code rapidement, plus le volume de pull requests à relire augmente. Résultat, les revues humaines se font à la va-vite et les bugs passent à travers les mailles du filet.

Anthropic a d’abord rodé Code Review en interne sur la quasi-totalité de ses pull requests. Avant son déploiement, 16 % des PR recevaient des commentaires de revue substantiels. Ce taux est passé à 54 % depuis. Sur les PR volumineuses (plus de 1 000 lignes modifiées), des problèmes sont détectés dans 84 % des cas, avec une moyenne de 7,5 anomalies identifiées. Moins de 1 % des remontées sont jugées incorrectes par les développeurs.

Code Review vs Claude Code Security

Disponible en research preview pour les plans Team et Enterprise

Code Review est accessible dès maintenant en research preview pour les plans Team et Enterprise de Claude Code. Les administrateurs l’activent depuis les paramètres Claude Code, sélectionnent les dépôts GitHub concernés, et le système s’exécute ensuite automatiquement à chaque nouvelle PR.

La facturation se fait au token, avec un coût moyen estimé entre 15 et 25 dollars par revue selon la complexité de la PR. Le temps de traitement moyen est d’environ 20 minutes. Les administrateurs peuvent définir un plafond mensuel de dépenses, activer l’outil sélectivement par dépôt et consulter un tableau de bord analytique dédié.